Parmi les entreprises les plus riches et les plus puissantes au monde, Google, Facebook, Amazon, Microsoft et Apple ont fait de l’IA un élément central de leur activité. Les progrès de la dernière décennie, en particulier dans une technique d’IA appelée apprentissage profond, leur ont permis de surveiller le comportement des utilisateurs ; leur recommander des nouvelles, des informations et des produits ; et surtout, ciblez-les avec des publicités. L’année dernière, l’appareil publicitaire de Google a généré plus de 140 milliards de dollars de revenus. Facebook a généré 84 milliards de dollars.

Les entreprises ont investi massivement dans la technologie qui leur a apporté une si grande richesse. La société mère de Google, Alphabet, a acquis le laboratoire d’IA basé à Londres DeepMind pour 600 millions de dollars en 2014 et dépense des centaines de millions par an pour soutenir ses recherches. Microsoft a signé un accord d’un milliard de dollars avec OpenAI en 2019 pour les droits de commercialisation de ses algorithmes.

Dans le même temps, les géants de la technologie sont devenus de gros investisseurs dans la recherche universitaire en IA, influençant fortement ses priorités scientifiques. Au fil des ans, de plus en plus de scientifiques ambitieux sont passés à travailler à temps plein pour des géants de la technologie ou ont adopté une double affiliation. De 2018 à 2019, 58% des articles les plus cités lors des deux principales conférences sur l’IA avaient au moins un auteur affilié à un géant de la technologie, contre seulement 11% une décennie plus tôt, selon une étude réalisée par des chercheurs du Radical AI Network, un groupe qui cherche à défier la dynamique du pouvoir dans l’IA.

Le problème est que le programme des entreprises pour l’IA s’est concentré sur des techniques à potentiel commercial, ignorant en grande partie les recherches qui pourraient aider à relever des défis tels que les inégalités économiques et le changement climatique. En fait, cela a aggravé ces défis. La volonté d’automatiser les tâches a coûté des emplois et conduit à l’augmentation du travail fastidieux comme le nettoyage des données et la modération du contenu. La poussée pour créer des modèles toujours plus grands a fait exploser la consommation d’énergie de l’IA. L’apprentissage en profondeur a également créé une culture dans laquelle nos données sont constamment grattées, souvent sans consentement, pour former des produits tels que les systèmes de reconnaissance faciale. Et les algorithmes de recommandation ont exacerbé la polarisation politique, tandis que les grands modèles linguistiques n’ont pas réussi à éliminer la désinformation.

C’est cette situation que Gebru et un mouvement croissant d’universitaires partageant les mêmes idées veulent changer. Au cours des cinq dernières années, ils ont cherché à déplacer les priorités du domaine loin du simple enrichissement des entreprises technologiques, en élargissant le nombre de personnes pouvant participer au développement de la technologie. Leur objectif n’est pas seulement d’atténuer les dommages causés par les systèmes existants, mais de créer une nouvelle IA plus équitable et démocratique.

« Bonjour de Timnit »

En décembre 2015, Gebru s’est assis pour rédiger une lettre ouverte. À mi-chemin de son doctorat à Stanford, elle avait assisté à la conférence Neural Information Processing Systems, le plus grand rassemblement annuel de recherche sur l’IA. Sur les plus de 3 700 chercheurs présents, Gebru n’en comptait que cinq qui étaient noirs.

Autrefois une petite réunion sur un sujet académique de niche, NeurIPS (comme on l’appelle maintenant) devenait rapidement la plus grande manne annuelle d’emplois en IA. Les entreprises les plus riches du monde venaient montrer des démos, organiser des fêtes extravagantes et rédiger de gros chèques pour les personnes les plus rares de la Silicon Valley : des chercheurs habiles en IA.

Cette année-là, Elon Musk est arrivé pour annoncer l’entreprise à but non lucratif OpenAI. Lui, Sam Altman, alors président de Y Combinator, et le cofondateur de PayPal, Peter Thiel, avaient investi 1 milliard de dollars pour résoudre ce qu’ils pensaient être un problème existentiel : la perspective qu’une superintelligence puisse un jour conquérir le monde. Leur solution : construire une superintelligence encore meilleure. Sur les 14 conseillers ou membres de l’équipe technique qu’il a nommés, 11 étaient des hommes blancs.

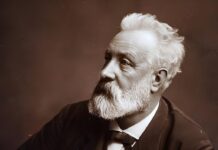

RICARDO SANTOS | PHOTO DE COURTOISIE

Pendant que Musk était encensé, Gebru faisait face à l’humiliation et au harcèlement. Lors d’une conférence, un groupe de gars ivres portant des t-shirts Google Research l’a encerclée et l’a soumise à des câlins indésirables, à un baiser sur la joue et à une photo.

Gebru a tapé une critique cinglante de ce qu’elle avait observé : le spectacle, le culte culte des célébrités de l’IA, et surtout, l’homogénéité écrasante. La culture des clubs de garçons, écrit-elle, avait déjà poussé les femmes talentueuses hors du terrain. Il conduisait également toute la communauté vers une conception dangereusement étroite de l’intelligence artificielle et de son impact sur le monde.

Google avait déjà déployé un algorithme de vision par ordinateur qui classait les Noirs comme des gorilles, a-t-elle noté. Et la sophistication croissante des drones sans pilote mettait l’armée américaine sur la voie des armes autonomes létales. Mais il n’y avait aucune mention de ces problèmes dans le grand plan de Musk pour empêcher l’IA de conquérir le monde dans un scénario futur théorique. « Nous n’avons pas à nous projeter dans le futur pour voir les effets négatifs potentiels de l’IA », a écrit Gebru. « C’est déjà en train de se produire. »

Gebru n’a jamais publié sa réflexion. Mais elle s’est rendu compte que quelque chose devait changer. Le 28 janvier 2016, elle a envoyé un e-mail avec comme objet « Hello from Timnit » à cinq autres chercheurs Black AI. « J’ai toujours été triste par le manque de couleur dans l’IA », a-t-elle écrit. « Mais maintenant j’ai vu 5 d’entre vous 🙂 et j’ai pensé que ce serait cool si nous commencions un groupe noir dans l’IA ou au moins nous connaissions. »

L’e-mail a suscité une discussion. Qu’est-ce que le fait d’être Noir a guidé leurs recherches ? Pour Gebru, son travail était en grande partie un produit de son identité ; pour d’autres, ce n’était pas le cas. Mais après s’être rencontrés, ils ont convenu : si l’IA devait jouer un rôle plus important dans la société, ils avaient besoin de plus de chercheurs noirs. Sinon, le domaine produirait une science plus faible et ses conséquences néfastes pourraient s’aggraver.

Un programme axé sur le profit

Alors que Black in AI commençait tout juste à fusionner, l’IA atteignait son rythme commercial. Cette année-là, 2016, les géants de la technologie ont dépensé environ 20 à 30 milliards de dollars pour développer la technologie, selon le McKinsey Global Institute.

Chauffé par l’investissement des entreprises, le terrain s’est déformé. Des milliers d’autres chercheurs ont commencé à étudier l’IA, mais ils voulaient surtout travailler sur des algorithmes d’apprentissage en profondeur, tels que ceux derrière les grands modèles de langage. « En tant que jeune doctorant qui souhaite obtenir un emploi dans une entreprise de technologie, vous réalisez que les entreprises de technologie sont axées sur l’apprentissage en profondeur », déclare Suresh Venkatasubramanian, professeur d’informatique qui travaille maintenant au Bureau de la politique scientifique et technologique de la Maison Blanche. . « Donc, vous déplacez toutes vos recherches vers l’apprentissage en profondeur. Ensuite, le prochain doctorant qui arrive regarde autour de lui et dit : « Tout le monde fait un apprentissage en profondeur. Je devrais probablement le faire aussi.

Mais l’apprentissage en profondeur n’est pas la seule technique dans le domaine. Avant son essor, il existait une approche différente de l’IA connue sous le nom de raisonnement symbolique. Alors que l’apprentissage en profondeur utilise des quantités massives de données pour enseigner aux algorithmes les relations significatives dans l’information, le raisonnement symbolique se concentre sur l’encodage explicite des connaissances et de la logique basée sur l’expertise humaine.

Certains chercheurs pensent maintenant que ces techniques devraient être combinées. L’approche hybride rendrait l’IA plus efficace dans son utilisation des données et de l’énergie, et lui donnerait les connaissances et les capacités de raisonnement d’un expert ainsi que la capacité de se mettre à jour avec de nouvelles informations. Mais les entreprises sont peu incitées à explorer des approches alternatives alors que le moyen le plus sûr de maximiser leurs profits est de construire des modèles toujours plus grands.